AiHubMix

一、是什么

AiHubMix 是一个面向开发者与企业的 多模型 LLM(大型语言模型)API 聚合服务/统一接口平台。

它将多个主流 LLM 模型(如 GPT‑4/Gemini/Claude/DeepSeek/Qwen 等)整合到一个统一的 API 接入入口。

它兼容 OpenAI 标准的 API 格式,使开发者能够“换模型”时无需大规模修改代码。

它还宣称支持 “无限并发 (unlimited concurrency)” 调用、企业级稳定服务以及更高集成灵活性。

二、核心功能

以下是 AiHubMix 的关键功能:

统一接口调用:用户只需使用一个 API 端点、一个密钥(API-Key),便能访问多个不同厂商的 LLM 模型。

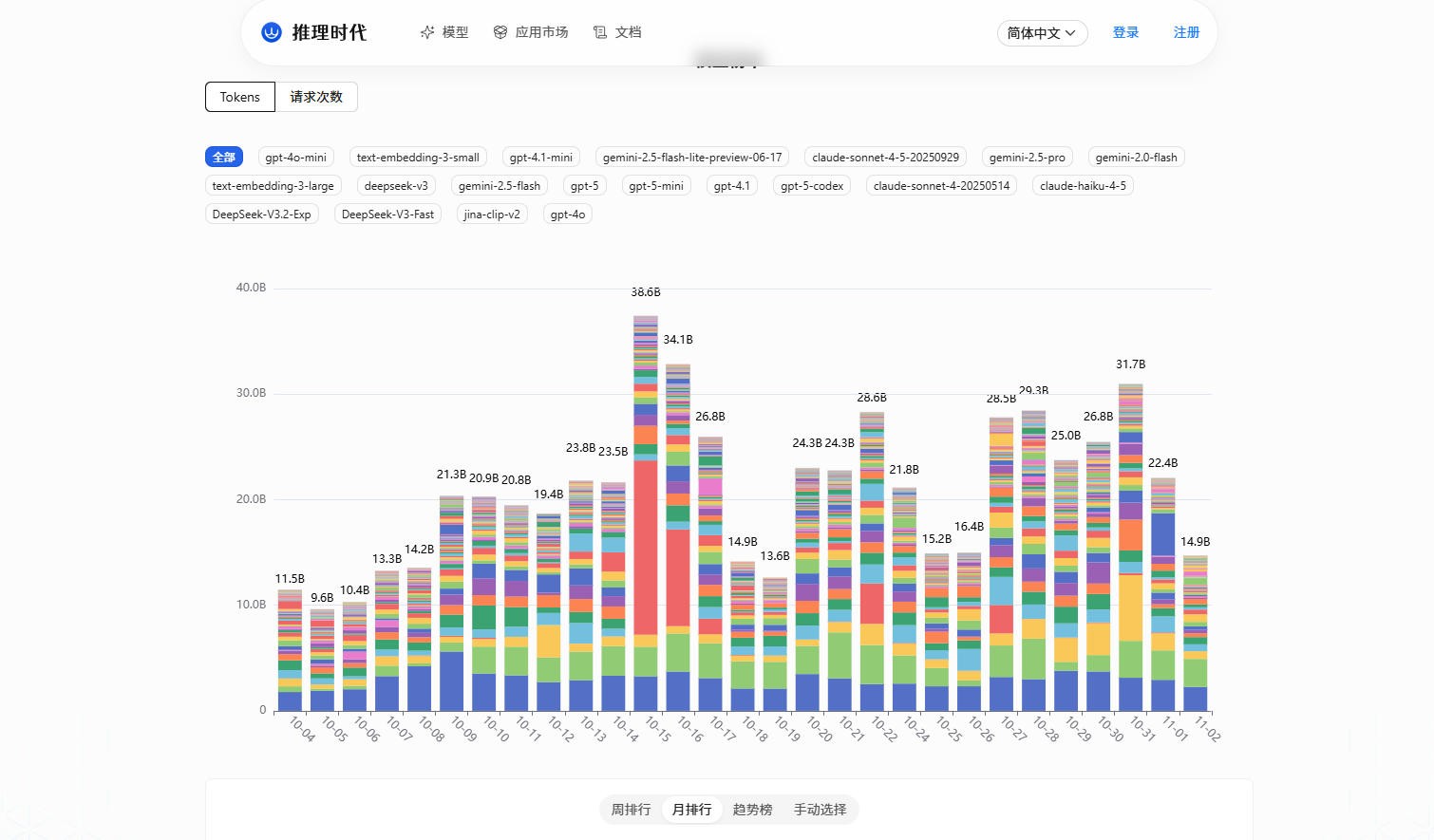

模型聚合:支持调用 OpenAI、Gemini、Claude、DeepSeek、Qwen 等多家模型,模型类型丰富。

兼容 OpenAI API 格式:开发者熟悉的 “/v1/chat/completions” 等接口可直接使用,大大降低学习成本。

高并发与企业级稳定性:适合需要大规模调用模型、并发量大的系统。

多模型切换灵活:在同一代码框架下,只需更换模型名称或参数,即可切换至不同模型提供商。

可用于文本/对话/图像模型(部分支持动态扩展) —— 如 “Ideogram-v3” 等文本→图像模型也有提及。

三、典型应用场景

AiHubMix 可在多种场景中发挥作用,包括但不限于:

多模型集成开发:当一个产品或服务希望灵活接入不同 LLM 模型以取最佳性能或成本结构时。例如:一个聊天机器人后台,可以测试使用 GPT-4、Gemini、Claude 哪个反应好,然后切换。

企业级 AI 提供:公司希望为其内部或外部服务提供 AI 能力,但不想绑定单一模型或服务商。使用 AiHubMix 可作为 “模型中介”层,未来可替换或升级背后模型更方便。

成本 &供应链优化:由于不同模型的定价、能力、响应延迟不同,使用统一入口可动态选择最合适模型,提高效率与成本效益。

研究/多模型对比:研究人员或 AI 工程师想要在一个环境中比较多个模型输出差异、性能、风格,从而评估最佳模型。

快速原型开发:开发者可用已熟悉的 OpenAI API 格式接入,快速构建原型,而背后可切换至不同模型或模型供应商。

混合模型策略:例如在同一应用中,针对不同任务调用不同模型:对话任务用 Gemini、高级推理用 Claude、图像生成用 Ideogram 等。统一平台使切换更简单。